Robô ensina como outras "máquinas" espalham machismo e outros preconceitos

Se você ainda não aprendeu como robôs, apesar de serem máquinas, podem ajudar a espalhar visões preconceituosas, a ONG britânica Feminist Internet (Internet Feminista, em inglês) vai dar uma mãozinha. Para fazer isso, encontrou o jeito mais mais irônico possível: criou um robô. Mas não é um robô qualquer.

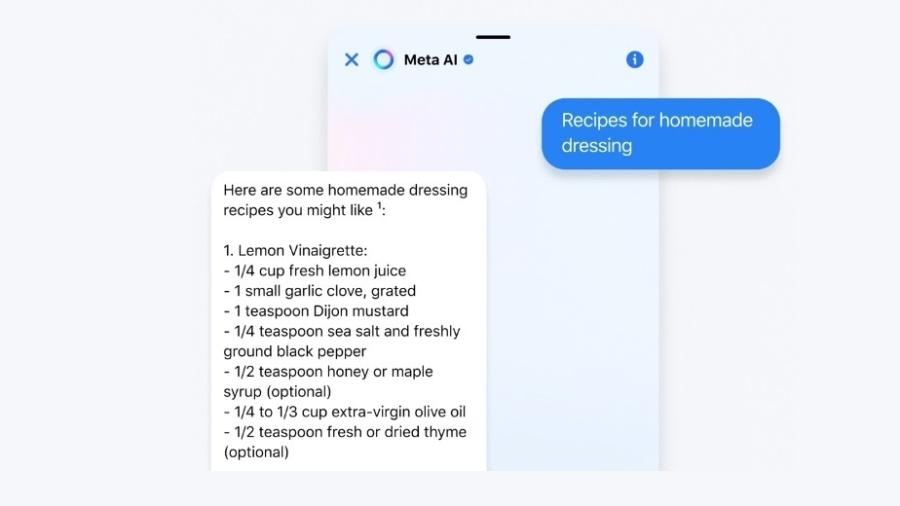

O F'xa é um chatbot (robô conversador) que fala com as pessoas para ensinar como funciona uma assistente virtual, como surgem o viés das inteligências artificiais e até sugere como podemos evitar comportamentos que reforcem estereótipos. Ele foi programado com valores feministas em mente, assim, a cada resposta dada, ela sustenta as crenças feministas que evitam disseminar preconceitos.

Para quem quiser tentar, o F'xa funciona apenas em smartphones e só fala inglês. Ele instrui os usuários sobre como as assistentes atuais dão um futuro sombrio as IA assistentes.

Por exemplo, ao ser perguntado como o preconceito se insinua nos sistemas de inteligência artificial, o F'xa respondeu:

O viés ocorre nos sistemas de inteligência artificial quando refletem preconceitos humanos mantidos pelas pessoas envolvidas na codificação, coleta, seleção ou uso de dados para treinamento

Ou seja, a visão preconceituosa que dentro de inteligências artificiais não está lá por acaso, mas, sim, foi transmitida pelos programadores que criaram o código ou inseriram os dados que alimentam esse sistema.

Desde o início da década, as gigantes empresas internacionais como Apple, Google, Microsoft e Amazon, trabalham em robôs que utilizam de inteligência artificial para ajudar usuários em seu dia a dia. Você já deve ter ouvido falar da Siri (Apple), Google Assistente, da Cortana (Microsoft) e da Alexa (Amazon). Mas, tirando o fato de serem IA assistentes, o que elas têm em comum? Exatamente: todas possuem "personalidades" femininas. É essa, pelo menos, a ideia que suas criadoras querem transmitir por meio das vozes e nomes dessas assistentes.

Apresentar essas características passou a atrair críticas para essas empresas. Isso porque esses robôs podem acabar reforçando o estereótipo de que mulheres devem desempenhar atividades como o de secretarias ou auxiliares. As empresas negam que as assistentes tenham gênero. Argumentam ainda que a escolha da voz foi feita com base em pesquisas com clientes. Apesar de hoje em dia a Siri e Google Assistente já terem a opção de voz masculina, essa alternativa não é uma configuração vinda de fábrica.

De acordo com uma pesquisa publicada em maio pela ONU, criar robôs virtuais com vozes e nomes femininos para desempenhar funções de auxiliar é um reforço de estereótipos sexistas. Como as assistentes são programadas para reagir de maneira educada e gentil ainda que sejam insultadas, os usuários acabam achando que o assédio pode ser normalizando.

Fora isso, algumas máquinas de inteligência artificial apresentaram comportamentos machistas. Em 2014, a Amazon criou uma IA para automatizar a busca por novos talentos. A máquina foi treinada para examinar os candidatos através dos currículos enviados nos últimos dez anos. A maioria desses currículos era de homens, refletindo o predomínio masculino no mundo da tecnologia.

A máquina acabou aprendendo que deveria priorizar homens e evitar mulheres. Com isso, qualquer currículo que tinha a palavra "mulheres" era preterido, fazendo com que menos candidatas fossem consideradas para uma vaga. E, de quebra, ampliava a presença masculina no ambiente de trabalho.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.