Ataque em mesquita: Facebook e Google agiram rápido, mas não foi suficiente

Resumo da notícia

- Atirador transmitiu o ataque ao vivo pelo Facebook

- Facebook retirou o vídeo do ar e bloqueou a conta do assassino, mas vídeo viralizou

- YouTube (do Google) afirmou que tem tomado medidas para conter a divulgação

- Apesar das iniciativas, as empresas estão sendo questionadas quanto a responsabilidade por suas plataformas

Ataques contra duas mesquitas na cidade de Christchurch, na Nova Zelândia, deixaram ao menos 49 mortos e dezenas de feridos nesta sexta-feira (15). Muitas perguntas ainda estão sem respostas, mas uma coisa é fato: o tiroteio em massa foi pensado estrategicamente para se espalhar pelas mídias sociais.

O ataque em uma das mesquitas foi transmitido ao vivo pelo Facebook. O vídeo de 17 minutos feito pelo próprio atirador também circulou pelo YouTube e Twitter. As cenas foram capturadas com uma câmera instalada no capacete do assassino.

Um manifesto de 74 páginas atribuído a ele também foi divulgado e em pouco tempo viralizou. O documento, cujo qual não vamos detalhar aqui, se baseia em discurso de ódio.

Não precisou de muito tempo para as empresas serem questionadas sobre a gravidade do problema e sobre suas responsabilidades.

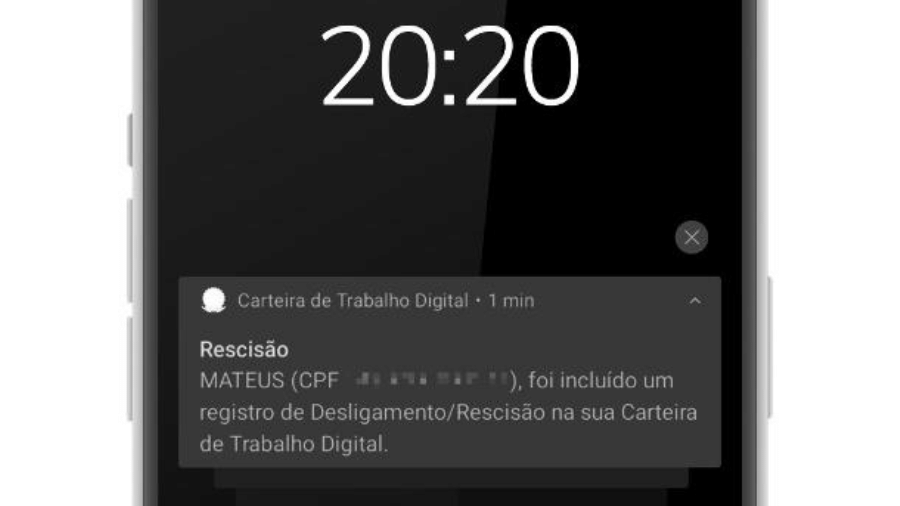

O Facebook removeu o vídeo de sua plataforma e bloqueou a conta do atirador também no Instagram assim que recebeu um alerta da Polícia da Nova Zelândia. Segundo o site Engadget, a empresa informou que também estava removendo qualquer elogio ou apoio ao crime e ao atirador.

O YouTube, de responsabilidade do Google, também tomou a mesma decisão e divulgou que a empresa estava atenta para remover qualquer cena violenta envolvendo o massacre.

O Twitter também bloqueou o perfil do australiano, segundo destacou o site The Verge.

Ao que tudo indica, as empresas de tecnologia agiram rápido para conter a propagação das cenas do ataque. Mas você sabe. Uma vez que algo é publicado na internet, é difícil voltar atrás.

As autoridades da Nova Zelândia fizeram um apelo para que as pessoas parem de compartilhar as cenas. Mas o vídeo não para de ser replicado - inclusive dentro das próprias plataformas acima. O manifesto já foi hospedado em sites de armazenamento de arquivos que não têm lá tanta supervisão.

Perdeu-se o controle (se é que algum dia ele existiu).

A polícia está ciente de que há imagens extremamente angustiantes relacionadas com o incidente em Christchurch circulando online. Nós insistimos fortemente que o link não seja compartilhado. Estamos trabalhando para ter qualquer cena removida Polícia da Nova Zelândia

O fato nos leva novamente a refletir sobre a responsabilidade das plataformas diante de atrocidades assim. Impedir a fácil divulgação de conteúdos nocivos é o principal desafio. O segundo, não menos importante, é lidar com a velocidade com conteúdos assim se espalham uma vez que já foram compartilhados.

Mesmo depois de o vídeo original do atirador ter sido retirado do ar, uma série de internautas se revoltaram com o fato de que o conteúdo ainda estava disponível nas redes sociais.

"Acho que cheguei ao meu momento de total desespero. O vídeo completo está em todo o YouTube. Todo o Facebook. Olha, um único upload no FB-23 mil visualizações em 1 hora. E 1000s lá fora. Nós simplesmente não podemos deixar o Facebook e o Google continuarem a operar além da lei. É insano", descreveu a jornalista Carole Cadwalladr, do The Guardian, com um print de tela comprovando sua fala.

As cenas do massacre só escancaram o jogo de gato de rato que presenciamos há anos. As redes sociais viraram ferramentas perfeitas quem deseja glamourizar crimes e divulgar violência explícita. A própria natureza de algumas plataformas acaba contribuindo indiretamente para isso.

As políticas de uso são claras: proíbem comportamentos abusivos, atos criminosos e a divulgação de certos tipos de conteúdos. Mas obviamente não são seguidas por todo mundo.

O desafio para as empresas fica ainda mais difícil quando vemos que funções criadas pensando em melhorar a experiência dos internautas (algumas feitas também para agradar anunciantes) se tornaram armas de propagação como os exemplos abaixo.

Transmissão ao vivo: com alguns cliques qualquer pessoa consegue fazer vídeos e divulgá-los em suas mídias em tempo real. Facebook, YouTube, Instagram, Twitter...

O algoritmo inteligente de cada plataforma já consegue identificar alguns tipos de conteúdos não aceitos (como nudez). Mas existe uma dificuldade técnica ainda deles detectarem algo proibido quando se trata de um vídeo ao vivo.

Por isso, atos de violência são facilmente transmitidos pelas plataformas. Até os sistemas detectarem, já é tarde demais.

Reprodução automática: você abre o seu perfil, começa a navegar e vídeos começam a rodar "do nada". É a reprodução automática. O recurso pode ser configurado para não funcionar, mas muita gente nem faz ideia disso.

Uma vez que ainda não existe um controle maior de possíveis violações das regras, vídeos com conteúdos nocivos facilmente vão circular e se espalhar.

De quem é a responsabilidade?

A responsabilidade por garantir a segurança de seus usuários evidentemente é de todas as plataformas. Seja envolvendo a proteção de dados, seja a proteção quanto a exposição a esse tipo de violência, seja quanto ao dever de tirar tudo isso do ar.

Mas os internautas também não devem ficar por aí replicando algo tão perturbador. A divulgação de vídeos com violência explícita, por exemplo, é proibida em todas elas.

Do ponto de vista das empresas, especialistas reforçam plataformas como Facebook, YouTube, Twitter (e outras) têm a obrigação de dar respostas mais rápidas a acontecimentos assim.

Além disso, elas precisam urgentemente melhorar os seus sistemas de inteligência artificial para que eles consigam bloquear com mais eficiência vídeos como o feito pelo atirador.

Um ponto positivo é que algumas ferramentas automatizadas já têm inteligência para remover certos tipos de conteúdos. Um exemplo é a tecnologia PhotoDNA, ferramenta da Microsoft usada pelo Facebook para identificar e remover imagens e vídeos de pornografia infantil, bem lembrou o site da Wired. O Google tem uma ferramenta com a mesma função.

Além disso, algumas tecnologias usadas pelas empresas funcionam para combater a propagação de vídeos envolvendo atos de terrorismo (como cenas que mostram práticas do Estado Islâmico).

O investimento em revisores humanos também é muito importante. A máquina ainda não consegue ter o discernimento necessário para avaliar os diferentes tipos de denúncias de violação de regras que chegam a todo instante.

Os fãs das plataformas também podem ajudá-las fazendo denúncias sobre qualquer comportamento que viole qualquer regra. As empresas fazem uma análise posterior e avaliam a gravidade da violação.

Algumas empresas de tecnologia batem na tecla sobre a dificuldade de seus sistemas reconhecerem discurso de ódio e violência. É um fato, elas estão erradas. Mas elas não podem se esconder por trás disso e fugir da responsabilidade e do dever de melhorarem suas plataformas.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.