Qual o elo entre o corretor do celular e a inteligência artificial na saúde

Resumo da notícia

- Privacidade é barreira para uso de dados de saúde na inteligência artificial

- Solução pode vir de tecnologia já usada pelo autocorretor de celulares

- Cria-se uma rede de dados que compartilha modelos, não dados brutos

- O processamento de dados distribuídos mantém informações em sigilo

Um dos principais desafios da adoção de tecnologias de aprendizado de máquina para treinar algoritmos de inteligência artificial sobre atividades humanas diz respeito à privacidade de dados. Para "aprender" bem, um algoritmo de inteligência artificial precisa de uma quantidade enorme de dados e, assim, uma quantidade enorme de informações sobre as pessoas. Essa é uma das principais dificuldades para o uso desse tipo de tecnologia na área de saúde, por exemplo.

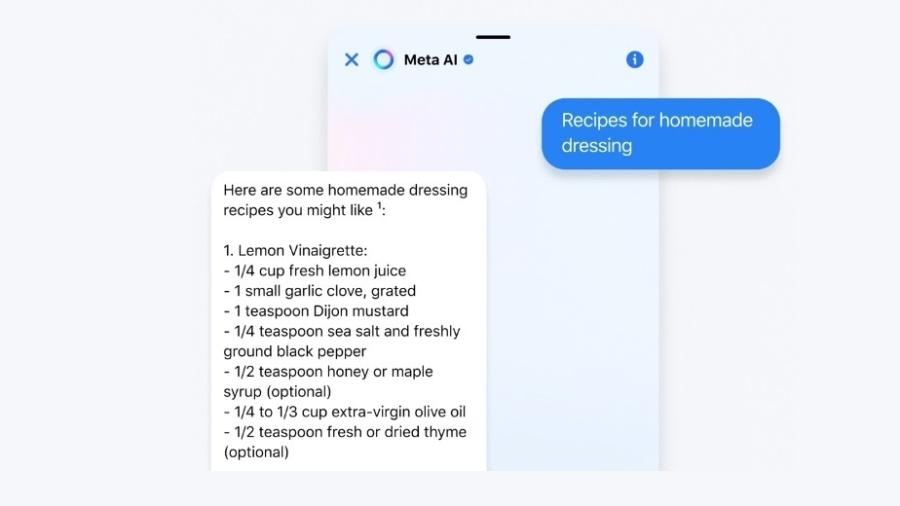

Agora o Google decidiu, entre outras coisas, treinar o seu modelo de texto preditivo usando todas as mensagens enviadas e recebidas pelos usuários de Android --e, dizem ele, sem a necessidade de que elas sejam lidas ou, ainda, coletadas dos smartphones.

Segundo a estratégia, a coleta de dados não ocorre de maneira centralizada, mas sim distribuída. A ideia é criar uma rede de processamento com diferentes centros de dados, em que as informações brutas não estão disponíveis para toda a rede.

No caso dos smartphones, em vez dos dados de utilização dos usuários serem mandados de forma bruta para uma central, eles são processados individualmente em cada aparelho e, então, enviados na forma de um modelo já compilado que, em tese, não daria acesso às informações brutas usadas para a criação do modelo.

Mesmo sem grande prestígio dentre a comunidade que estuda e desenvolve inteligência artificial, esse modelo de obtenção de dados pode ser a solução para que a inteligência artificial seja mais bem utilizada na área de saúde.

Uma vez que se utilize um modelo que permita um processamento prévio de dados para que apenas modelos de informação sejam utilizados para treinar algoritmos, a questão da ética médica em relação à privacidade de dados do paciente deixaria de ser um problema.

IA pode agilizar diagnósticos

Um dos principais intuitos da utilização de inteligência artificial na área de saúde é o de agilizar diagnósticos --o que, no caso de doenças graves, pode aumentar consideravelmente as chances de cura ou os anos de vida.

Há, contudo, desafios. Um deles é o risco de que, ao combinar algoritmos diferentes criados em centrais distribuídas, o resultado possa ser menos preciso do que as partes que foram utilizadas em sua criação. A infraestrutura dos hospitais bem como a necessidade de pessoas treinadas para alimentar cada algoritmo local também são algumas dificuldades.

O pesquisador do MIT (Instituto de Tecnologia de Massachusetts) Ramesh Raskar, que é especializado no uso de inteligência artificial na área de saúde, afirmou ao site Technology Review que já estão sendo criadas técnicas para que alguns desses problemas não ocorram.

Raskar e seus alunos, por exemplo, desenvolveram uma técnica que faz com que cada ponto de uma rede distribuída de aprendizado de máquina processe apenas parte de um modelo. Essas partes são então enviadas para uma central de processamento para, então, serem combinadas e aprimoradas. Essa seria uma solução para dispensar a necessidade de ter hospitais com equipamentos com alta capacidade de processamento, e ainda assim manter a privacidade dos dados coletados.

Caso esse tipo de tecnologia passe a ser utilizada na área de saúde, o caminho fica aberto para que esse tipo de modelo de aprendizado de máquina seja utilizado em outras áreas nas quais a privacidade é fundamental.

"Em ambientes distribuídos e sem confiança, isso será algo muito poderoso no futuro", afirmou Raskar.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.