WhatsApp fará parceria contra desinformação nas eleições, diz TSE

Resumo da notícia

- TSE comemora adesão do WhatsApp a programa de combate à desinformação

- Parceria já valerá para as eleições municipais de 2020

- TSE quer disseminar informações sobre a confiabilidade do sistema eleitoral

- Facebook, Google e Twitter manterão parcerias com o tribunal

- Gabinete de Segurança da Presidência também está firmando acordo com TSE

O TSE (Tribunal Superior Eleitoral) está firmando parcerias com o WhatsApp, o Facebook, o Google e o Twitter para combater a desinformação nas eleições municipais de 2020. A grande novidade, comemorada pela Justiça Eleitoral, é a adesão do aplicativo de troca de mensagens, que será firmada na próxima terça-feira (22).

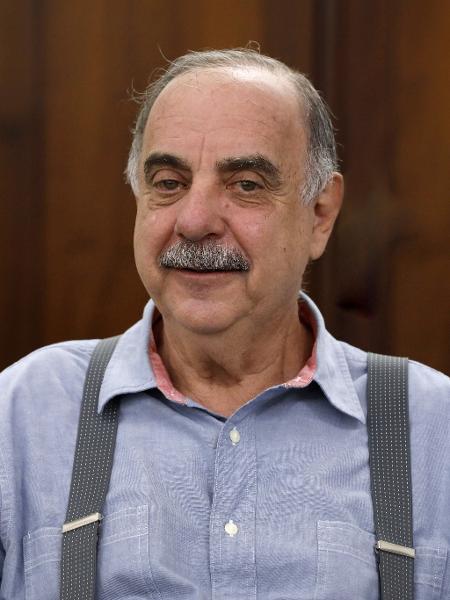

"Eles [o WhatsApp] foram bastante refratários [nas eleições de 2018], mas agora estão mais abertos. O cenário mudou, e a gente está muito feliz com essa adesão deles ao programa", afirmou Ana Cristina Rosa, assessora-chefe de Comunicação do TSE, em entrevista após participar hoje do seminário "Desinformação: antídotos e tendências", organizado pela ANJ (Associação Nacional de Jornais) em São Paulo.

"A nossa expectativa é que através da parceria com o WhatsApp, a gente consiga ter, por parte da plataforma, ferramentas que nos ajudem a potencializar a disseminação do nosso conteúdo verdadeiro, mas não tem nada ainda fechado. O primeiro passo é a subscrição desse termo de adesão ao programa", comenta Ana Rosa. Procurado pela reportagem, o WhatsApp não se manifestou.

A preocupação da Justiça Eleitoral é disseminar conteúdos sobre a confiabilidade do processo eleitoral e da segurança da urna eletrônica. As outras três plataformas — Facebook, Google e Twitter - já colaboraram com o tribunal em 2018.

No ano passado, sobretudo no primeiro turno das eleições, houve uma grande disseminação de conteúdos que colocavam em dúvida o funcionamento das urnas, sugerindo que o sistema fraudava os resultados.

Durante a palestra no seminário da ANJ, a assessora reconheceu que o volume de ataques pegou o TSE de surpresa em 2018. "Fomos surpreendidos com esse tsunami de ataques à instituição no primeiro turno da eleição. A sensação é que a gente estava sendo soterrado pelas coisas mais absurdas e disseminadas numa velocidade muito rápida. Não estávamos preparados para responder porque era o uso do WhatsApp com uma ferramenta de disseminação de conteúdo, os grupos bombando. E a gente (...) sem condições de dar resposta nesse mesmo ritmo."

O tribunal tem 35 parceiros no programa de combate à desinformação, entre empresas, entidades públicas e partidos políticos. O formato de cada acordo será definido individualmente.

Com o WhatsApp, o combate à propagação de conteúdos enganosos, incluindo os disparos em massa, pode ficar de fora da parceria. "Essa questão está judicializada, está em avaliação do tribunal. Nesta semana mesmo, houve movimentos nesse processo a partir do reconhecimento do WhatsApp de houve, sim, disparos múltiplos em massa [em 2018]", diz Ana Rosa.

Outra novidade é a adesão do GSI (Gabinete de Segurança Institucional), vinculado à Presidência da República. "A Presidência da República montou uma equipe de checagem. A nossa expectativa é poder contar com o apoio desse grupo, que está sob o comando do GSI, no que diz respeito ao monitoramento da 'deep web' (camada da internet que não pode ser acessada através de mecanismos de busca). A Justiça Eleitoral ainda não tem esse alcance", declara a assessora.

Áudios são terreno fértil para 'deep fakes', diz especialista

Uma das técnicas mais avançadas de desinformação é o uso de "deep fakes", que são conteúdos manipulados por meio de inteligência artificial. Eles podem servir, por exemplo, para colocar a imagem ou a voz de uma pessoa em uma situação mentirosa; ou até mesmo para a criação de uma pessoa totalmente inventada.

O jornalista Sam Gregory, diretor da ONG Witness e especialista na pesquisa sobre "deep fakes", disse em sua palestra no evento da ANJ que hoje em dia mais de 90% desse tipo de conteúdo é usado para cometer violência de gênero —em geral, imagens de mulheres são colocadas em situações pornográficas com o objetivo de expô-las e desacreditá-las, desde atrizes de cinema a jornalistas.

Segundo Gregory, houve poucas suspeitas de uso de "deep fakes" em política até agora, mas isso está no horizonte da prática. Para ele, podem ficar especialmente vulneráveis não os políticos de alcance nacional ou global, mas aqueles de atuação local.

"Alguém como o presidente dos EUA é vulnerável a deep fakes, mas por outro lado há mecanismos de detecção desenvolvidos especificamente para políticos de alto escalão, há mais infraestrutura para combatê-los. Um deep fake será danoso para um político, mas eu me preocupo menos com Donald Trump do que com um político em nível estadual que não tem os mecanismos de detecção construídos para ele", disse ao UOL após a palestra.

Gregory explica também que os "deep fakes" não existem só em vídeo, e que outros tipos de conteúdo, como áudios, também dão trabalho para serem desmentidos.

"Dublagem e manipulação de áudio têm alto potencial de danos. Particularmente aqui no Brasil, sabemos como áudios circulam. E o áudio é mais difícil [de detectar], porque há menos pistas nele para desmenti-lo. Já vimos exemplos de áudios deep fake usados para fraudes contra empresários."

Para o pesquisador, no entanto, ainda não há motivo para pânico, já que mesmo a maioria do conteúdo produzido para desinformar não é "deep fake". De qualquer forma, ele alerta que é necessário se preparar para o avanço e a disseminação das tecnologias usadas para esse fim.

Segundo Gregory, as plataformas onde este tipo de conteúdo é divulgado devem ser cobradas não só para estabelecer regras sobre a publicação de "deep fakes" — já que podem ser usados para sátiras, por exemplo — como para desenvolver ferramentas que auxiliem na detecção destes materiais.

"Há uma urgência sobre como treinar jornalistas para estarem prontos para isso. Pode não ser no ano que vem, mas a tendência tecnológica sugere que [produzir deep fakes] ficará mais e mais fácil, e as pessoas começam a usar as ferramentas à medida que elas ficam mais fáceis de usar."

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.