'Ninguém quer calar o cidadão comum', diz consultor da lei das fake news

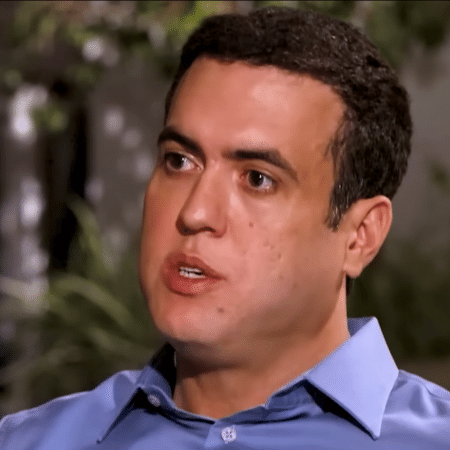

O jurista Ricardo Campos é diretor do instituto LGPD (Legal Graunds for Privacy Design) e professor assistente da Goethe Universität Frankfurt am Main, na Alemanha, na cátedra de direito de mídia. Por essa circunstância, assistiu de camarote à promulgação da lei alemã contra discurso de ódio na internet, em 2017.

Inspirado na experiência da Alemanha, elaborou, em conjunto com Juliano Maranhão, professor de Direito da Universidade de São Paulo, uma proposta de lei para o Brasil que foi em grande parte incorporada ao Projeto de Lei contra as fake news (em português, notícias fraudulentas ou desinformação) aprovado no Senado no final de junho e que agora está sendo discutido na Câmara dos Deputados.

"Temos um diálogo muito próximo com os deputados", diz Campos, que rechaça a noção de que a lei poderá servir para reduzir a liberdade de expressão nas redes sociais, apesar de dizer que ainda há melhorias possíveis no texto. Ele concedeu a seguinte entrevista à coluna:

O PL 2630/20, que, se aprovado, vai instituir a Lei Brasileira de Liberdade, Responsabilidade e Transparência na Internet, está sendo chamado de "lei das fake news", mas em nenhum trecho apresenta uma definição do que é fake news ou desinformação. Isso é bom?

É muito importante não ter uma definição. O objeto da lei é a escala industrial da desinformação. Isso você consegue controlar pelo comportamento inautêntico de contas. A lei não quer atingir o tiozão do WhatsApp, o cidadão comum, mas sim quem está pagando para uma conta publicar 20.000 posts por dia, por exemplo.

Qual é a definição de comportamento inautêntico?

Comportamento inautêntico coordenado liga duas características que estão por trás de toda campanha de desinformação: utilização de contas falsas e atividade anormal.

Recentemente, o Facebook derrubou contas e páginas ligadas ao bolsonarismo por comportamento inautêntico. Esse episódio reforça a necessidade da lei?

A chave para enfrentar a desinformação está no relatório do Facebook [em que a investigação da plataforma é detalhada]. A estrutura do relatório é a de uma Polícia Federal, só que privada. Ela começa com uma argumentação jurídica, vai esmiuçando fatos e depois coloca as fotos dos possíveis criminosos. Tem que interpretar a derrubada de contas no contexto do boicote de grandes empresas, como Coca-Cola e Unilever, à publicidade no Facebook. O boicote a redes sociais que não combatem suficientemente o discurso de ódio e a desinformação representa um prejuízo maior do que o lucro inteiro do Facebook em 2019.

Por ter pegado no bolso do Facebook, a plataforma virou uma Polícia Federal privada. Isso é um problema. O grande desafio da lei brasileira é conseguir institucionalizar esse mecanismo. A derrubada das contas mostra que isso é tecnicamente possível. Mas isso não pode servir para atacar grupos políticos, isso é muito perigoso. Tem que valer para todo mundo e para os próximos 100, 200 anos. A diferença do estado de Direito para uma entidade privada é que o primeiro não pode ficar à mercê de pressões econômicas.

Qual é o alvo do PL das fake news, as empresas de redes sociais ou seus usuários?

O objeto da lei são empresas com mais de 2 milhões de usuários, o que abarca todas as empresas grandes. O ponto central é regular comportamentos anormais: ver quem está influenciando a esfera pública e saber se o conteúdo é ilegal. São os chamados comportamento inautênticos.

A maior farsa em torno do debate sobre o projeto de lei é que ele tem que ser principiológico. Vai defender a dignidade da pessoa humana na lei? Isso já está na Constituição. A lei tem que ser procedimental, ter obrigações claras para as plataformas, para que elas adotem certos procedimentos.

O senhor pode dar um exemplo?

Hoje as plataformas podem excluir qualquer conta que viole seus termos de uso e compromisso, pois trata-se de uma relação privada entre o usuário e as empresas. Só que elas não dão direito de resposta. Isso é um problema. Lembra do caso do Revoltados Online, uma página do Facebook que fez sucesso durante os protestos de 2013? Era uma plataforma de direita, em que circulavam milhões de pessoas. Da noite para o dia, a página foi retirada do ar. E o dono do Revoltados Online não teve direito de resposta.

O grande desafio é obrigar a plataforma a dar direito de defesa, sem precisar envolver a Justiça em um primeiro momento. Da mesma forma, permitir que o cidadão comum que é difamado possa notificar um conteúdo sem precisar sair de casa para procurar a Justiça. Quem procura decisão judicial? O Aécio Neves, a Caroline Dieckmann. O cidadão comum não tem dinheiro nem tempo para isso.

O projeto de lei tem isso, no artigo 12, quando trata da moderação de conteúdo, sobre o direito de recorrer da remoção de um conteúdo. O texto da lei ainda pode melhorar, mas esse é o caminho.

Segundo o projeto de lei, a quem cabe decidir quando há comportamento inautêntico na internet?

O PL estabelece o princípio da autorregulação regulada, com o desafio de criar um mecanismo dinâmico entre o Estado, que tem pouco conhecimento na área digital, e a iniciativa privada, que é onde está esse conhecimento. Foi o que vimos no relatório do Facebook: sem as plataformas não tem como fazer combate à desinformação. Só com código penal, aumentando pena, não resolve. É preciso ter esse mecanismo para que o Estado consiga fazer pedidos mais rápidos, que não sejam judiciais.

A lei dá um passo importante, que é o de obrigar as plataformas a fazer relatórios com dados de contas inautênticas e outros tipos de conta. Outro ponto é a criação de um conselho com capacidade para implementar boas práticas. A sociedade é nova e a gente precisa de um novo Direito.

A ONU e a OEA enviaram ao governo brasileiro um relatório criticando o PL e dizendo que ele viola a liberdade de expressão. A crítica tem fundamento?

Eu fiquei um pouco chocado, porque tem um ponto em que o documento fala que a lei vai afetar o jornalismo tradicional. Mas o artigo 5, parágrafo único, do projeto de lei exclui todas as empresas de jornalismo tradicionais. Eles [os representantes da ONU e da OEA] não leram o projeto de lei. Talvez não tivessem uma tradução para o inglês ou foram pautados de maneira equivocada. É um absurdo.

Mas tem alguns pontos corretos, que é o artigo 10, que trata da rastreabilidade e é o ponto mais sensível da lei. A crítica é que, para garantir uma maior responsabilização, serviços como WhatsApp têm que armazenar por três meses todas as mensagens. Isso vai contra a autonomia privada do WhatsApp. Por ter criptografia de ponta a ponta, o aplicativo não guarda o que está sendo comunicado. Houve uma mudança para exigir apenas os metadados: não se exige mais que eles guardem o conteúdo, e sim quem mandou para quem em que horário.

Ainda assim, permanecem várias questões sensíveis de privacidade. Mas tem uma saída, que vamos propor agora, para manter o espírito do artigo 10. O grande argumento contra ele é que há um armazenamento muito grande e isso fere a proteção de dados. As empresas privadas vão ter que guardar tudo. A saída seria, se o objetivo da lei é combater a desinformação, exigir o armazenamento apenas de mensagens de comportamentos inautênticos, que representam só 1% do total. Isso incluiria, por exemplo, metadados de contas que enviam 2.000 mensagens por dia.

Dessa forma, não há violação de dados desproporcional ao objetivo da lei, que é controlar e punir a desinformação.

O relatório da ONU também afirma que, ao coibir o uso de robôs que enviam mensagens em massa nas redes sociais, pode-se acabar prejudicando serviços legítimos de utilidade pública, não só desinformação.

De fato, diversos entes públicos e a iniciativa privada trabalham com robôs para enviar informações importantes. Mas há uma saída: se existir um selo de autenticação para o robô, deixando claro que suas mensagens ou postagens são uma comunicação artificial. Isso não atinge a liberdade de expressão. O tribunal, o ente público ou a iniciativa privada com atuação autêntica não têm problema nenhum em serem rotulados como robôs.

De que forma esse projeto de lei pode coibir a desinformação?

O ponto mais importante é diferenciar o objeto da lei e focá-lo na escala industrial da desinformação. A escala individual fica totalmente de fora. Está em discussão agora um artigo penal para focar na escala industrial para pegar, por exemplo, quem financia. Mas como vai saber quem financia? Aí entra o papel da lei que é o de estabelecer mecanismos de transparência para o juiz poder saber decidir. Se ele tiver acesso, por meio desses mecanismos de transparência, às contas, ao movimento inautêntico, vai saber julgar claramente e aplicar o tipo penal.

Realmente não é algo fácil. São dois níveis. O primeiro é estabelecer mecanismos de transparência para saber como está sendo formada a desinformação na esfera pública. No segundo passo entra a questão da Justiça penal. Na questão eleitoral, por exemplo, se for possível saber mais ou menos como está se formando a árvore de desinformação, depois é possível punir. Só que sem as plataformas digitais, sem relatórios, sem compliance, não tem como fazer isso, porque o mecanismo anterior, de decisão judicial, perde o sentido quando acaba a eleição.

Decisões do STF têm derrubado contas de políticos e apoiadores do bolsonarismo. O inquérito sobre fake news do STF tem uma efetividade para combater desinformação, na sua opinião, ou pode levar à censura?

O inquérito desde início foi objeto de muito debate. Mas se a gente deixar a questão jurídica de lado e olhar a questão política, é preciso reconhecer que as instituições estavam sendo atacadas. Fabrício Benevenuto, da Universidade Federal de Minas Gerais, desenvolveu um sistema para ver as informações que estão rodando no dia. Naquela época, antes do inquérito, na véspera de uma pauta do STF ou do Congresso Nacional, os mesmos memes estavam circulando nos grupos de WhatsApp. Existia uma coordenação de como as pessoas recebiam informação e era algo sem transparência. Alguém estava financiando aquilo. Esse inquérito veio para romper com isso. E, do ponto de vista político, eles exerceram uma pressão que efetiva. Há uma pressão clara do STF que está, de certa forma, também chamando a atenção das plataformas.

A lei tem que estabelecer mecanismos de estado de Direito para isso, para esse problema da desinformação. Não dá para esperar as empresas sentirem no bolso antes de decidirem combater a desinformação. Ter de esperar abrir um inquérito, cuja procedência é discutível, para só então as plataformas fazerem algo. Precisa de algo estável. A questão da desinformação em massa não pode continuar como está.

A lei ainda não está muito redonda, mas ela melhorou demais. Eu acompanhei o processo. O que foi entregue para a Câmara dos Deputados já avançou muito e dá para melhorar ainda mais.

A questão da identificação das contas por RG é um problema, viola a privacidade?

Pode ser, mas a questão central a se perguntar é se uma pequena violação da privacidade é proporcional ao objetivo da lei. Por exemplo, as contas que têm uma proporção muito grande de comunicação. Não seria exigível delas uma identificação?

Da minha avó e do seu tio, não. Mas uma conta que publica numa proporção muito maior do que um ser humano seria capaz de publicar? Essa conta não teria uma necessidade de identificação? Isso viola a privacidade por quê? Eu não vejo problema de privacidade aí.

O problema está em exigir identificação de pessoas que fazem um uso normal das redes sociais, como estava originalmente no projeto do senador Ângelo Coronel. Mas como está agora, de exigir uma notificação na plataforma, isso é interessante. Você, como jornalista, vê contas difamando incessantemente e poderá clicar lá e exigir identificação daquela conta, por que não? Aí a plataforma suspende a conta até ela identificar e depois volta.

A lei fake news poderá ser usada para censura?

Ninguém está ali querendo censurar ninguém. Não tem nenhum deputado ou senador que está querendo calar a todos. Ninguém quer calar o cidadão comum.

O projeto de lei brasileiro é uma versão branda da lei alemã? Por quê?

A lei alemã combate o discurso de ódio. Já a lei brasileira quer tratar da desinformação. A lei alemã exige a exclusão em 24h de conteúdo manifestamente ilegal, mediante notificação. Por exemplo, se você foi difamado, você clica lá e o conteúdo tem que ser apagado em 24h. Se eles não apagarem, a multa é de vários milhões de euros. A lei alemã é muito dura. Ela impõe muitas obrigações às plataformas. E ela tem um dever de compliance muito alto. O Facebook teve que contratar muita gente na Alemanha para fazer esse trabalho. E a lei especifica o treinamento dessas pessoas.

O problema brasileiro é a desinformação. A gente não tem, por exemplo, essa cláusula de 24h para apagar conteúdo após notificação. Por isso é mais branda. Mas, aí é o ponto central, a lei brasileira não é principiológica, de querer impor boas práticas. A lei brasileira dá um passo, como a alemã, de obrigar as plataformas a ter certos procedimentos. Por exemplo, relatórios e direito de defesa dentro da plataforma, sem precisar recorrer ao judiciário.

Pode-se dizer que em determinado aspecto o projeto de lei potencializa a liberdade de expressão?

Esse é um aspecto da lei que não está tão ligado à desinformação: trata-se de permitir, a pessoas de bem que tiveram um post excluído, que se defendam. Um dos grandes problemas, e isso a gente vai propor para melhorar, é que a plataforma atualmente pode simplesmente excluir o seu post com a alegação de que feriu os termos de uso de conteúdo. A pessoa não fica nem sabendo o porquê. Não pode isso. As plataformas têm que falar qual foi o post derrubado e em quê ele violou os termos de uso. Isso é o básico para a pessoa poder exercer o direito de defesa.

Esse ponto, na lei, ainda não está bom. O projeto já sinalizou que tem que ter direito de defesa, pois essas plataformas são hoje a infraestrutura pública da comunicação. Elas são privadas, mas são a esfera pública. A sua liberdade de expressão é potencializada ali. Quando ela é violada, você tem que ter um direito de defesa diante do ente privado.

O PL tenta deixar esses mecanismos de remoção de conteúdo mais transparentes?

Sim, a lei toca numa caixa preta das plataformas digitais, porque elas apagam o que elas querem. Toda a responsabilidade jurídica gira em torno de um artigo do Marco Civil que é o 19. Ele é muito simples: a plataforma só é responsável por cumprir uma decisão judicial. Se você quer uma remoção de conteúdo, você precisa de uma decisão judicial.

Por outro lado, se a plataforma quer remover um conteúdo, faz isso na hora que ela quer. Sem dar explicação. Isso tem que acabar. Se existir o direito de defesa e a plataforma concluir mesmo assim que houve violação, a pessoa que se sentiu lesada leva todo aquele histórico para a Justiça. Já tem tudo pronto. Um juizado especial decide aquilo em 5 minutos.

Então, para concluir, o projeto de lei de fake news não fere a liberdade de expressão, mesmo em sua versão atual?

Não. As pessoas podem ler a lei. As empresas afetadas são as de maior valor de mercado do planeta. Na Alemanha, professores, institutos, jornalistas, todo mundo falava mal da lei, porque as empresas pagavam institutos e pareceres. Era uma avalanche de informação contra a lei. Três meses depois da promulgação da lei, todo mundo se deu bem, até as plataformas. Não foi tão difícil. E, hoje, sabe o que está acontecendo? A pauta principal da ministra da Justiça é aprimorar a lei. Já tem duas propostas no Parlamento alemão para enrijecer a lei.

A gente tem que tomar cuidado com as ideias que querem poluir a discussão pública. A melhor dica é ler o projeto de lei.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.